في خطوة قد تعيد تشكيل طريقة تطوير أنظمة الذكاء الاصطناعي، نجح باحثون من Korea Advanced Institute of Science and Technology في ابتكار أسلوب تدريبي جديد يمكّن النماذج الذكية من الاعتراف بحالة “عدم اليقين”، بدلًا من تقديم إجابات خاطئة بثقة مفرطة. ويأمل العلماء أن تسهم هذه التقنية في جعل تطبيقات الذكاء الاصطناعي، من السيارات ذاتية القيادة إلى التشخيص الطبي، أكثر أمانًا وموثوقية.

الدراسة قادها البروفيسور Se-Bum Paik، وشارك فيها الباحث جيونغهوان تشيون، ونُشرت في دورية Nature Machine Intelligence بتاريخ 9 أبريل 2026، بعد مراجعة علمية محكمة.

المشكلة: الذكاء الاصطناعي الواثق من الخطأ

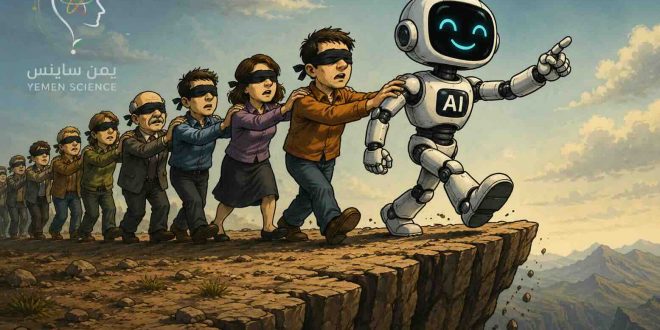

تعاني أنظمة الذكاء الاصطناعي الحديثة من مشكلة معروفة تُسمى “الثقة المفرطة” أو Overconfidence، حيث تُصدر النماذج تنبؤات أو إجابات خاطئة لكنها تعرضها بدرجة عالية من الثقة، ما قد يؤدي إلى نتائج خطيرة في التطبيقات الحساسة.

وتظهر هذه المشكلة بوضوح في أنظمة القيادة الذاتية أو أدوات التشخيص الطبي أو حتى روبوتات المحادثة التوليدية، التي قد “تختلق” معلومات غير صحيحة بطريقة تبدو مقنعة للغاية، فيما يُعرف بظاهرة “الهلوسة” في الذكاء الاصطناعي.

اكتشاف غير متوقع داخل مرحلة التهيئة

توصل الفريق البحثي إلى أن جذور المشكلة قد تبدأ منذ اللحظة الأولى لبناء الشبكة العصبية الاصطناعية، أي خلال مرحلة “التهيئة العشوائية” المستخدمة على نطاق واسع في التعلم العميق.

فعند إدخال بيانات عشوائية عديمة المعنى إلى نموذج لم يتعلم أي شيء بعد، لاحظ الباحثون أن النموذج أظهر ثقة مرتفعة بإجاباته رغم افتقاره الكامل للمعرفة. وبحسب الدراسة، فإن هذا الانحياز المبكر قد يستمر لاحقًا أثناء التدريب ويؤثر في سلوك النموذج النهائي.

استلهام الحل من الدماغ البشري

استلهم العلماء فكرتهم من طريقة تطور الدماغ البشري قبل الولادة. إذ تُظهر الأبحاث العصبية أن الدماغ يُنتج نشاطًا عصبيًا تلقائيًا حتى قبل استقبال أي مدخلات حسية من العالم الخارجي، ما يساعد على تشكيل الدوائر العصبية الأولية.

وانطلاقًا من هذا المبدأ، طوّر الباحثون ما أطلقوا عليه “مرحلة الإحماء” أو Warm-up، حيث يُدرَّب النموذج لفترة قصيرة على ضوضاء عشوائية قبل تعليمه البيانات الحقيقية.

الفكرة الجوهرية هنا أن النموذج يتعلم أولًا حالة “أنا لا أعرف شيئًا بعد”، بدلًا من البدء بثقة غير مبررة. وبعد هذه المرحلة، تصبح مستويات الثقة لدى النموذج أكثر اتساقًا مع دقة إجاباته الفعلية.

ذكاء اصطناعي يعرف حدود معرفته

أظهرت النتائج أن النماذج التي خضعت لمرحلة الإحماء أصبحت أكثر قدرة على التعامل مع البيانات غير المألوفة. فبدلًا من تقديم إجابات خاطئة بثقة عالية، بدأت هذه النماذج بخفض مستوى ثقتها عندما تواجه معلومات لم ترها سابقًا أثناء التدريب.

ويُعد ذلك تقدمًا مهمًا فيما يُعرف بقدرة “ما وراء الإدراك” أو Meta-cognition، أي قدرة النظام على التمييز بين ما يعرفه وما يجهله.

وقال البروفيسور سي-بوم بايك إن الدراسة تُظهر أن دمج مبادئ مستوحاة من تطور الدماغ يمكن أن يجعل الذكاء الاصطناعي أكثر شبهًا بالبشر في إدراكه لحالة معرفته الخاصة، موضحًا أن أهمية هذه الخطوة لا تقتصر على تحسين دقة الإجابات، بل تمتد إلى تمكين الأنظمة من فهم لحظات الشك واحتمالات الخطأ.

تطبيقات واسعة في المستقبل

يتوقع الباحثون أن تُستخدم هذه التقنية في العديد من المجالات التي تتطلب موثوقية عالية، مثل المركبات ذاتية القيادة، والأنظمة الطبية الذكية، ونماذج الذكاء الاصطناعي التوليدي.

كما تشير الدراسة إلى أن طريقة “الإحماء” الجديدة قد تصبح جزءًا أساسيًا من آليات تهيئة معظم نماذج التعلم العميق مستقبلًا، نظرًا لبساطتها وإمكانية دمجها بسهولة في الأنظمة الحالية.

محددات الدراسة

ورغم النتائج الواعدة، لا تزال الدراسة بحاجة إلى اختبارات أوسع على نماذج ضخمة ومتنوعة تعمل في بيئات حقيقية ومعقدة، خاصة أن سلوك أنظمة الذكاء الاصطناعي قد يختلف باختلاف نوع البيانات وحجم النماذج المستخدمة. كما أن تقليل الثقة المفرطة لا يعني بالضرورة القضاء الكامل على الأخطاء أو الهلوسة، لكنه يمثل خطوة مهمة نحو بناء أنظمة أكثر شفافية وأمانًا.

Yemen Science يمن ساينس: الشبكة اليمنية للعلوم والبيئة، موقع يهتم بأخبار العلوم والتكنولوجيا والصحة والبيئة والسكان

Yemen Science يمن ساينس: الشبكة اليمنية للعلوم والبيئة، موقع يهتم بأخبار العلوم والتكنولوجيا والصحة والبيئة والسكان