كتب عبد الرحمن مطهر أبو طالب*

الذكاء الاصطناعي هو سلوك وخصائص معينة تتسم بها البرامج الحاسوبية تجعلها تحاكي القدرات الذهنية البشرية وأنماط عملها لاسيما قدرتها على التعلم والاستنتاج ورد الفعل على أوضاع لم تبرمج في الآلة.

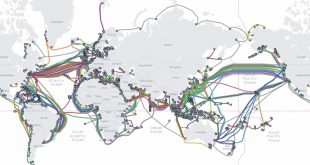

أصبح الذكاء الاصطناعي هو الموضة الجديدة التي يدور الحديث حولها في كل المجالات، في أجهزة الهواتف الذكية، في الأجهزة المنزلية، في التلفزيونات، في الأسلحة، وأيضاً في السيارة الذكية التي يفترض أن تنتشر قريباً في الشوارع من دون سائقين. أينما التفتنا سنجد تقنيات الذكاء الاصطناعي وقد باتت تؤثر على غالبية جوانب حياتنا بشكل أو بآخر؛ بدءاً من اختيار أي كتب أو بطاقات سفر سنشتريها عبر شبكة الإنترنت، مروراً بتحديد ما إذا كانت طلبات التوظيف التي قدمها أيٌ منّا قد لاقت النجاح أم لا، وصولاً إلى تحديد ما إذا كان المرء مُستَحِقاً لقرضٍ مصرفي من عدمه، أو حتى طبيعة العلاج الذي يتعين الخضوع إليه.

كل ما سبق ذكره وغيره كثير صار قابلاً لأن يُحدد الآن آلياً إلى حدٍ كبير عن طريق أنظمة وبرمجيات معقدة. فتقنيات الذكاء الاصطناعي قطعت خلال السنوات القليلة الماضية أشواطاً هائلة بشكل لافت للنظر. كما أن هذه التقنيات تنطوي على إمكانيات من شأنها جعل حياتنا أفضل، في نواحٍ كثيرة. وقد بدا صعود نجم الذكاء الاصطناعي خلال الأعوام الأخيرة أمراً حتمياً. فقد خُصصت أموالٌ طائلة للشركات الناشئة العاملة في هذا المجال. كما أنشأت الكثير من شركات التكنولوجيا القائمة بالفعل مختبرات بحثية جديدة لتطوير تقنياتها على هذا الصعيد.

ومع التطور الهائل في مستوى التكنولوجيا وتطبيقاتها، فقد باتت تقنيات الذكاء الاصطناعي تؤثر على حياتنا حالياً على نحوٍ أكثر أهمية من أي وقت مضى؛ وربما تتدخل فيها أيضا، وقد يتحول الأمر إلى أخطار أخرى؛ روبوتات سيصل ذكاؤها إلى درجة تسمح لها باستعبادنا، بخاصة مع قدرات الذكاء الاصطناعي، أو فيروسات حاسوبية مدمرة توقف الإنترنت عن العمل. لهذا، يرى العديد من الخبراء حول العالم أن الوقت قد حان لأن يتدخل مفكرو علم الأخلاق وفلاسفته لضبط هذا الأمر.

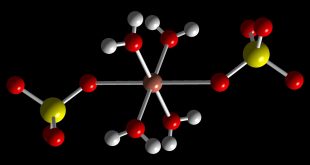

الخوارزميات، قلب الذكاء الاصطناعي

تؤثر الخوارزميات، التي تمثل القلب النابض للذكاء الاصطناعي، على كثير من جوانب الحياة من بين جملة أمور أخرى. وبسبب كفاءتها وسرعتها، تتخذ الخوارزميات القرارات وتنفذ اجراءات نيابة عن البشر في كثير من المجالات. ومع استمرار ازدياد اعتماد الذكاء الاصطناعي على الخوارزميات يتعين علينا معرفة ماهي العواقب والمخاطر المترتبة على هذا الاعتماد؟ ومن الضروري بلوغ فهم أفضل للمواقف تجاه الخوارزميات وأشكال التفاعل معها. لهذا، من المفيد قبل أن نمضي قدما أن نبحث بشكل دقيق في ماهية الخوارزميات.

لقد شهد هذا المفهوم بعض التغيير على مر القرون. فقد كان أبو عبد الله بن موسى الخوارزمي – العالم المسلم من القرون الوسطى الذي اشتُق اسم الخوارزمية من اسمه – مهتماً بابتكار إجراءات تفصيلية للتوصل إلى الحلول الحسابية للمعادلات وانتهى التعريف بالخوارزمية في عصرنا الحالي إلى كونها متتالية محدودة من الأوامر البرمجية الدقيقة القابلة للتنفيذ في الأنظمة الحاسوبية. وربما يذّكرنا هذا بإجراءات الحفظ عن ظهر قلب المدعومة بالعقل، مثل وصفات تحضير أطباق الطعام أو الخطوات المتبعة لحساب ضريبتك باتباع خوارزميات بوصفها كود برمجي لمعالجة الارقام ببراعة.

يزداد اعتماد صناع القرار ومحللي السياسات حاليًا على الخوارزميات وهم يحاولون اتخاذ قرارات فعالة في الوقت المناسب في عالم غني بالبيانات، ويتضمن استخدامهم للخوارزميات كوسائل مساعدة على اتخاذ القرارات تفاصيل هامة ولكنها ليست ذات صلة بالقرار. وهذه فائدة قوية لوسائل المساعدة الخوارزمية على اتخاذ القرارات. فالخوارزميات التي تعمل بشكل صحيح تطلق العنان لقدرة صناع القرار المعرفية من أجل المداولات الهامة الأخرى.

غير أن غموض الخوارزميات يجعل من الصعب الحكم على صحة الأداء وتقويم المخاطر وتقييم العدالة في التطبيقات الاجتماعية. كما يمكن للغموض أن يحجب الفهم السببي وراء القرارات. قد تكون هذه المسائل غير ضارة إذا كانت الخوارزميات (شبه) ُمنزهة عن الخطأ، ولكن معظم الخوارزميات لا تضمن الدقة سوى ضمانات احتمالية وحسب، وهذا في أفضل السيناريوهات الممكنة حيث يتم تطبيق النماذج والخوارزميات الصحيحة بشكل مناسب، مع توافر أفضل النوايا تجاه “إتمام” البيانات. ونادرا ما يكون لدى مصممي الخوارزميات ومستخدميها رفاهية هذه السيناريوهات المثالية، إذ عليهم أن يعتمدوا على الافتراضات التي يمكن أن تفشل وتؤدي إلى نتائج غير متوقعة.

الذكاء الاصطناعي وتدريب الآلة

يبدو أن خوارزميات الذكاء الاصطناعي التي لم تخضع للتجريب والتدريب الجيد قد تؤدي بالآلة إلى اتخاذ قرارات خاطئة، مما يعتبر مشكلة تتطلب حلا جذريا. على سبيل المثال، نشرت صحيفة ليزيكو الفرنسية تقريرا ضربت فيه كاتبة التقرير دبورا لوي مثالا على أخطاء خوارزميات الذكاء الاصطناعي هو تصنيف نظام قوقل للتعرف على الوجه في عام 2015 صورة لشخص أميركي من أصل أفريقي في فئة “الغوريلا”. كما أوردت قصة الباحثة في معهد ماساتشوستس للتكنولوجيا جوي بولامويني ذات البشرة السوداء التي اكتشفت بالصدفة وهي تجرب برنامج تعرف على الوجه أنه لا يتعرف على وجهها، في حين أنه يتعرف بشكل جيد على وجوه أصدقائها، فدفعها ذلك لارتداء قناع أبيض، وكانت المفاجأة أن البرنامج تعرف فورا على “وجهها”. ومن هذه التجربة قررت بولامويني إعداد عرض قدمته في مؤتمر “الإنصاف والمساءلة والشفافية” الذي عقد في جامعة نيويورك، وقد كشفت في هذا العرض عن عيب رئيسي في الذكاء الاصطناعي يمكن أن تكون له عواقب واسعة وخطيرة.

والواقع أنه للتعرف على الوجه وتسجيله في فئات مختلفة -مثل الجنس أو العمر- لا بد أن تتدرب الخوارزميات على قواعد البيانات، فعلى سبيل المثال بمجرد أن يرى الجهاز عددا من الوجوه المرتبطة بصفة “المرأة” يمكنه التعرف على امرأة أخرى غير موجودة في الصور التي عالجها، ولكن إذا كانت قاعدة البيانات غير متنوعة بما فيه الكفاية -على سبيل المثال إذا لم يكن بها ما يكفي من صور النساء السود- فذلك يعني أن الخوارزمية لم تكن مدربة تدريبا جيدا.

الاستعداد لمواجهة مخاطر الذكاء الاصطناعي

ومع زيادة وتنويع استخدامات الذكاء الاصطناعي يمكن أن تكون لهذه الأخطاء عواقب كارثية، فالمستقبل سيجعل من الخوارزميات وسيلة للتنبؤ، إذ سوف تساعد مصرفنا على اتخاذ قرار بإعطائنا قرضا أو حرماننا منه، وستساعد طبيبنا على معرفة العلاج المناسب، فالذكاء الاصطناعي يوفر القدرة على أتمتة عملية صنع القرار مع تدخل بشري ضئيل أو منعدم كليا، وعلينا بالتالي أن نكون يقظين كي لا تضخم هذه القرارات الآلية التحيزات البشرية، وهو بالضبط ما تنادي به كارولين لير المؤسس المشارك لهيئة تطلق على نفسها “نساء في الذكاء الاصطناعي”. وبما أن هذه المشاكل قد تم تحديدها فإن العديد من الباحثين يعملون الآن على حلها، حيث أعلنت شركة “آي.بي.أم” الأميركية عن أداة لتحليل كيف ولماذا تتخذ الخوارزميات القرارات في الوقت الحقيقي، وذلك بهدف منع الذكاء الاصطناعي من التمييز ضد جماعات معينة مثل النساء والأقليات.

وقالت الشركة إن بإمكان حزمتها “فيرنيسكت” البحث عن علامات تحيز والتوصية بإجراء تعديلات. ويأتي تطوير هذه الأداة لمواجهة القلق المتزايد بأن الخوارزميات التي تستخدمها شركات التقنية العملاقة والشركات الأخرى لا تكون دائما عادلة في صنع القرار. فعلى سبيل المثال، فشلت في الماضي أنظمة التعرف على الصور في التعرف على وجوه الأشخاص غير البيض كما ذكرنا في قصة قوقل مع الغوريلا. ونظرا لأن تلك الخوارزميات تتخذ قرارات مؤتمتة بشكل متزايد حول مجموعة واسعة من القضايا مثل التأمين والمعلومات التي يشاهدها الناس على الإنترنت، فإن الآثار المترتبة على توصياتهم تصبح أوسع نطاقا. وغالبا مع تعمل الخوارزميات ضمن ما يعرف باسم “الصندوق الأسود”، مما يعني أنه لا يمكن لمالكيها رؤية كيف تتخذ هذه الخوارزميات القرارات.

لم تكن “آي.بي.أم” الشركة الوحيدة في مجال مجابهة مخاطر الذكاء الاصطناعي. تعمل شركات تقنية أخرى أيضا على تطوير حلول لمواجهة تحيز تقنيات الذكاء الاصطناعي، فقد أعلن الرئيس التنفيذي لشركة قوقل سونداربيتشاي عن تحول أولوية الشركة من “الموبايل أولاً” إلى “الذكاء الاصطناعي أولاً” منتصف العام 2017. ومنذ ذلك الحين، استثمرت الشركة بشكل كبير في أبحاث التعلم الآلي، حيث طورت تطبيقات متطورة قادرة على أن تفكر أساساً في نفسها. مجهودات الشركة في أبحاث الذكاء الاصطناعي أسفرت عن ميزات برمجية جديدة مفيدة بالفعل؛ حيث أطلقت قوقل مؤخرا أداة تدعى “ماذا لو”، مصممة لمساعدة المستخدمين على معرفة كيفية عمل نماذج تعلم الآلة. كما قالت مايكروسوفت إنها تعمل في الآونة الأخيرة على مجموعة أدوات لكشف تحيز خوارزميات الذكاء الاصطناعي، بينما قالت فيسبوك إنها تختبر أداة لمساعدتها في تحديد ما إذا كانت خوارزمية معينة متحيزة أم لا. وتؤكد رئيسة الذكاء الاصطناعي وتعلم الآلة في المنتدى الاقتصادي العالمي كاي فيرث بترفيلد أن الذكاء الاصطناعي يواجه مشكلة تحيز، ويتمثل جزء من المشكلة في أن كميات البيانات الهائلة التي تتدرب الخوارزميات على التعامل معها لا تكون دائما متنوعة بشكل كاف.

ولأهمية التعاون في التصدي لهذه المشكلة، أنشأت شركات “فيسبوك” و”قوقل” و”أمازون” اتحاد شركات (كونسورتيوم) في سبتمبر من العام 2016، بهدف إيجاد حلولٍ لمشكلات الذكاء الاصطناعي وسبل لمواجهة المخاطر المتعددة والمتنوعة التي يطرحها استخدام تقنيات الذكاء الاصطناعي فيما يتعلق بالسلامة والخصوصية. كما تم تأسيس شركة بحثية غير هادفة للربح، تحمل اسم “أوبن آيه إل” بهدف تطوير تقنيات “ذكاء اصطناعي” مفتوحة المصدر والترويج لها، من أجل تحقيق صالح الجميع. ويقول نورفيغ المسؤول في “قوقل” إن من الأهمية بمكان أن “يتم إجراء أبحاث بشأن التعلم الآلي بشكل علني وشفاف، وأن يجري توسيع رقعة انتشارها من خلال منشورات علنية وشفرة مفتوحة المصدر، وهو ما سيجعل بمقدورنا جميعاً تقاسم” المنافع الناجمة عن ذلك.

أخلاقيات الذكاء الاصطناعي

في هذا الصدد ينظر جوناثان زيتراين، أستاذ التشريعات القانونية المتعلقة بشبكة الانترنت في كلية الحقوق بجامعة هارفارد الأمريكية أن ثمة خطرٌ ناجمٌ عن كون التزايد المطرد في تعقيد الأنظمة الحاسوبية قد يحول دون إمكانية إخضاع هذه الأنظمة لعمليات التدقيق الشديدة التي نحتاج إليها. ويقول زيتراين: “أشعر بالقلق حيال تضاؤل استقلالية الإنسان، في ظل ما تتسم به أنظمتنا – مُدعومةً بالتكنولوجيا – من تعقيد متزايد وترابط على نحو محكم”. ويضيف بالقول “إن إقدامنا على تطوير نظم الذكاء الاصطناعي مُتجاهلين ما ينطوي عليه الأمر من مخاطر في بعض الأحيان، ربما سيحدونا للشعور بالندم على الطريقة التي قد يتطور بها نظامٌ ما من هذه الأنظمة، وكذلك حيال عدم إفساح المجال بشكل واضح لكي يُوضع البعد الأخلاقي موضع الاعتبار في هذا الصدد”. مضيفا “من المهم تشكيل فرق ولجان تضم خبراء في علم الأخلاق وفي التكنولوجيا بجانب مسؤولين تنفيذيين في الشركات العاملة في هذا المجالات؛ وذلك إذا ما كنا بصدد وضع معايير مهنية وصناعية وأخلاقية، فيما يتعلق باستخدام تقنيات الذكاء الاصطناعي وبلورة فهمٍ كامل بشأن ما هو موضوعٌ على المحك في هذا الصدد.

في نهاية المطاف يقول زيتراين: “عملنا لا ينصب على القلقٍ إزاء قدرة إنسانٍ آلي من إحدى قصص الخيال العلمي على السيطرة، وإنما يرتبط أكثر بأن نرى كيف يمكن استخدام التكنولوجيا لتعزيز التفكير والتأمل البشريين، وعملية صنع القرار التي يقوم بها بني البشر، فالأمر يرتبط هنا بتسخير هذه التقنيات لتحسين أداء البشر في أمورٍ يبذلون فيها بالفعل قصارى جهودهم، لا أن تشكل تلك الأجهزة بديلاً للبشر في هذا الأمر بالكامل”.

ويساور مبعث القلق هذا خبراء آخرين من بينهم ميسي كمينغس، مديرة أحد مختبرات جامعة ديوك بولاية نورث كارولاينا الأمريكية، والتي كانت من بين النسوة الأوُلْ اللواتي قُدنّ طائراتٍ مقاتلة تابعة للأسطول الأمريكي، وهي الآن خبيرة في الطائرات بدون طيار. وتعبر كمينغس عن مخاوفها في هذا الشأن بطرح هذا السؤال: “كيف سيمكننا أن نُصادق على كون هذه المنظومات آمنة؟”. وتقول كمينغس في هذا الصدد: “ليس لدينا في الوقت الحاضر أي نهجٍ متفقٍ عليه. دون وجود معيارٍ صناعيٍ لاختبار مثل هذه الأنظمة، سيكون من العسير تطبيق تلك التقنيات على نطاق واسع”.

في الختام، تحتاج تقنيات الذكاء الاصطناعي إلى إشراف ورقابة، ولكن لم تتضح بعد الطريقة المثلى لتحقيق ذلك على أرض الواقع. ولابد من القول بأنه إذا كانت المخاطر التي قد تصاحب تطور تكنولوجيا الذكاء الاصطناعي قد طرحت عالميا فإن تسويتها ستظل شائكة، إذ علينا أن نجد الأدوات التقنية الضرورية “لتصحيح” الخوارزميات، ولا بد قبل ذلك من اتفاق دولي لتحديد المجتمع الذي نريده والقيم التي نعتبرها غير قابلة للتصرف، وإذا نجحنا في ذلك يمكن للذكاء الاصطناعي حينها أن يحمي الإنسان.

*خبير بالمركز العربي لأبحاث الفضاء الإلكتروني

Yemen Science يمن ساينس: الشبكة اليمنية للعلوم والبيئة، موقع يهتم بأخبار العلوم والتكنولوجيا والصحة والبيئة والسكان

Yemen Science يمن ساينس: الشبكة اليمنية للعلوم والبيئة، موقع يهتم بأخبار العلوم والتكنولوجيا والصحة والبيئة والسكان